从空间构建到世界生成

重构 AI 训练的起点

今天,你我正站在**时代的分界线上。**

今天,你我正站在时代的分界线上。今天,

AI不再只停留在像素和文字,

它正走向我们身处的「物理世界」

看得见世界,

摸得到边界,

不等于真正学会世界

从“看见”到“理解”再到“行动”,

关键在于对空间的真正掌控。

当AI进入物理世界,**学习的方法也必须改变。**

当AI进入物理世界,学习的方法也必须改变。它必须能够从视觉、空间、时间和交互信号中,学习物理世界的结构与规律。

物理意义上的高精度理解与控制,

对象级别的灵活生成、编辑与重构。

更重要的是

能够像迭代模型一样快速迭代空间场景,

并在此基础上持续扩展训练数据。

因此

下一代的物理AI,

只靠现有仿真技术已经不够。

传统仿真

先定义世界,再运行世界

以人工搭建场景、规则和参数为基础,

通过引擎运行得到测试环境、场景结果或训练数据。它的核心是显式构造与 simulator-centric 的系统组织方式。

生成式 AI 增强仿真

仿真引擎仍是中心,AI 用于增强构建效率

在仿真框架中引入生成式 AI,

以提升资产生成、场景搭建或内容扩展的效率与真实感。本质上仍是围绕仿真器组织系统,只是引入了新的增强工具。

但可惜的是,即便是融入了生成式AI的增强仿真,

它也依然只是故有路径上的线性延伸。

它当然可用,甚至很重要,只可惜

它依然改变不了「人工构造」的本质。

既然没有改变本质,也就改变不了瓶颈。

跨本体迁移成本高

传统仿真往往依赖针对特定环境与机器人的 点对点工程适配,导致 迁移成本高、泛化也更脆弱。相比之下,Video-first / World-action 路线更有机会学习更普适的 物理演化规律,从而提升 跨本体迁移 能力。

任务相关性不天然成立

一个 可运行的世界,并不自动等于一个对训练真正有价值的世界。传统仿真擅长构造环境,却不天然回答:哪些 空间关系、交互过程 与 未来状态 最值得模型学习。

Content Gap 仍难弥合

Sim-to-Real 的难点并不只在 视觉逼真度,更在于对象种类、交互模式与真实世界 内容分布 的差异。只提升渲染和表面真实感,并不能自动弥合 Content Gap。

长时程建模仍然薄弱

在 遮挡追踪、任务阶段切换、异常恢复 等长时程任务中,传统仿真路线更难自然形成连续、稳定的 世界表征。新的 Video / World-model 路线,则更强调对 未来世界状态 的持续预测与建模。

长尾覆盖依然昂贵

依赖手动扩展 3D 资产、规则和参数 来覆盖 长尾场景,成本高且扩展慢。即使加入生成式 AI,只要系统仍以 人工构造 为中心,覆盖开放世界长尾的效率提升仍然有限。

加了 AI,不等于换了底层路线

把生成式 AI 作为 插件 接入旧框架,并不等于改变了系统的本质。真正的区别不在于有没有用 AI,而在于 AI 是 外部增强工具,还是组织 世界表示 与 训练闭环 的 系统核心。

对象级编辑,

本来就不该是问题。

Prompt: “add a glass and place it on magzine”

真正有价值的图像数据,

从来不止于图片本身。

真正有价值的视频数据,

也不该止于视频本身。

一个可学习的世界, 不会只输出一种数据。

从对象编辑到图像、视频与物理信息,训练接口本来就该是完整的。

让世界知识进入训练,

就是这么简单。

具身操作

第一人称交互,也能成为训练接口。

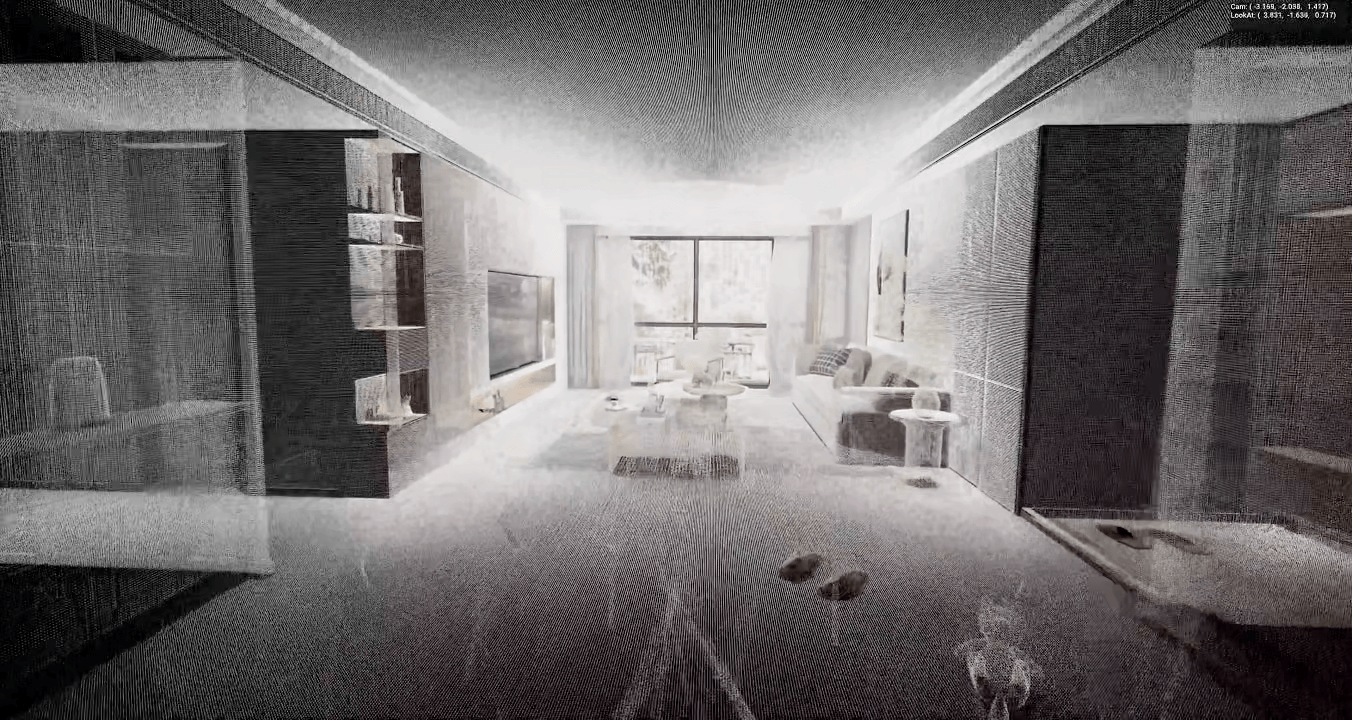

家庭空间

训练数据,终于可以被主动随心定义。

开放道路

长尾场景,不必再被动等待。

敏感场景

合成数据的价值,也包括隐私保护。

真正决定上限的,是非常规 case。

比如,撸个猫吧。

Physical AI 的边界,

只能是想象力。

当AI从语言世界走向物理世界,

真正的问题不再只是“有没有数据”,

而是有没有一种有效的方式去

构建、表示、生成并持续扩展世界数据。

这正是 JoinAI 在做的事:

为Physical AI构建学习物理世界的基础设施。

不交付数据,只交付效果。